3 月 27 日凌晨 2:00 PT,Google 推出了 2026 年首个广泛核心更新(Broad Core Update)。距离 垃圾更新完成才过了两天,距离 Discover 核心更新完成才过了一个月。30 天内三次官方确认的算法调整叠加,传统的流量归因模型正面临严峻考验。

4 月 8 日更新:March 2026 Core Update 已于 4 月 8 日 06:00 PDT 正式完成推送,历时 12 天。以下分析已更新为包含完整数据的终版。

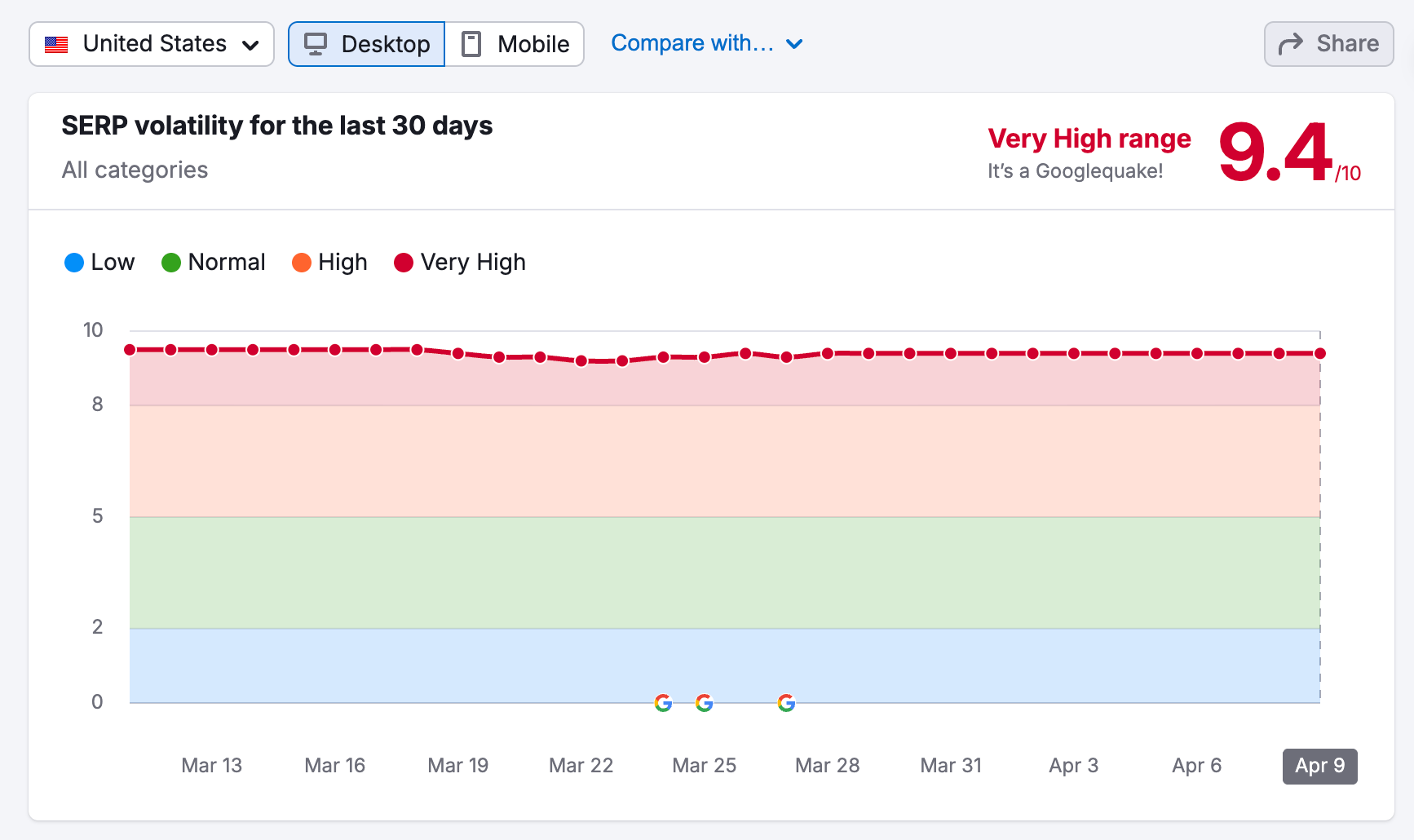

整个 Q1 的 SERP 波动极为剧烈。Semrush Sensor 峰值触达 9.5/10,被分析师称为 "Googlequake"。更新完成后的最终统计显示:超过 55% 的被监测站点出现了可衡量的排名变动。

Reddit r/SaaS 上的一个帖子标题很有代表性——"SEO for SaaS just changed overnight"——反映的是 Q1 以来靠 AI 批量堆内容冲排名的站点集体遭受打击的情绪。

但需要先厘清一件事:3 月 27 日的核心更新刚刚开始推送,Google 说要两周才能完成。目前我们能看到的大部分数据(流量暴跌、可见度变化),实际上混杂了 1-2 月的未命名质量波动、3 月 24 日的垃圾更新以及核心更新的早期影响。下面的分析会尽量标注每个观察的时间归属,但完全干净的归因,要等更新结束后至少一周才有可能。

现在更新已完全落地,我们终于可以做相对干净的归因。不过仍需注意:Q1 的数据混杂了 1-2 月的未命名质量波动、3 月 24 日的垃圾更新以及核心更新本身的影响。Google 建议等 4 月 15 日之后再做正式复盘——基线对比以 3 月 27 日前的数据为准,对照 4 月 8 日之后的表现。

最终数据:核心更新打了谁、救了谁

Google 官方对这次核心更新的描述一如既往地笼统:"a regular update designed to better surface relevant, satisfying content for searchers from all types of sites." 没有新的专项指导。

但 12 天推送结束后,数据层面的结论已经非常清晰。我们 3 月 28 日发布初版时的几个预判,全部被最终数据验证。

1. 自推销列表文章持续失效

Lily Ray(Amsive SEO VP)在 Substack 上详细拆解过这个模式:一批 SaaS 网站买精确匹配域名,批量发布 "十大最佳 XX 工具" 的列表文章,然后把自家产品永远放在第一位。她追踪了约 30 个符合这一模式的站点,发现它们在 1 月下旬到 2 月初的波动中已经出现了 29% 到 49% 不等的可见度下跌。

注意:这些下跌发生在核心更新之前,主要与 1-2 月的未命名排名调整相关。但它释放的信号非常明确——Google 正在系统性地识别并降权 "自己推荐自己" 的伪客观评测模式。核心更新是否会加速这一趋势,是接下来两周最值得监测的数据之一。

2. "Mt. AI" 现象:AI 规模化内容的流量崩塌

Glenn Gabe(GSQi 创始人)创造了一个形象的比喻——"Mt. AI"(AI 山峰)。他在 X 和 LinkedIn 上多次分享案例:一些网站靠 AI 工具日产数百篇内容,流量图表形成急速攀升的山峰,随后在算法调整中遭遇近乎垂直的崩塌。

这里面有一个关键细节:Google 打击的不是 "AI 生成" 这个动作本身,而是 "规模化生产且无附加价值" 的结果。Gabe 在追踪中发现,缺乏人类专家监督、没有原创数据支撑的 AI 内容,无论发布量多大,在近期的多轮波动中都表现极差。这个观察覆盖的是 2025 年底到 2026 年 Q1 的完整周期,不仅限于 3.27 这一次。

业界对背后机制的主流推测是:Google 正在加强基于语义理解的内容评估,可能借助了 Gemini 系列模型的能力,更精准地计算页面的 " 信息增益 "——即你的内容比已有排名结果多提供了什么。需要说明的是,"Gemini 语义过滤" 是行业推断,不是 Google 官方确认的机制名称。但底层逻辑是一致的:如果一个页面只是把排名前十的文章用更流畅的语言重写了一遍,它在算法眼中的独特价值越来越低。

这和我们之前在信息增益实操里讲的完全一致:AI 可以 30 秒写出 2000 字,但它写不出你的一手经验。

3. E-E-A-T 审查持续收紧

E-E-A-T 不是新概念,但 2026 年 Q1 的多轮波动把它的实际权重拧得越来越高。

Reddit r/SaaS 和 r/SEO 上大量运营者抱怨可见度暴跌,社区里资深 SEO 给出的诊断反复指向同一个问题——缺乏真实的作者背书。没有可验证的作者履历、用 "编辑团队" 做模糊署名、缺乏外部权威站点的信任引用,这些信号的负面权重在明显上升。

尤其是 YMYL(健康、金融、法律)领域。Reddit 上一位用户分享了 16 个月的追踪数据:2000 篇纯 AI 生成的 YMYL 文章,能留在索引里的不到 15%。这个数据覆盖的是从 2024 年底到 2026 年初的完整周期,不是单次更新的结果,但它反映了一个持续加强的趋势。

赢家长什么样

CSW Agency 和 Sistrix 对 3 月波动期(包括垃圾更新和核心更新早期)的可见度数据做了追踪分析。以下数据来自 CSW 的英国市场样本,是区域性观察而非全球数据:

清晰的意图架构。Uniqlo.com 在英国市场获得了约 76% 的可见度提升,Notonthehighstreet.com 增长了 56%。这些品牌没有做大量文字堆砌,而是凭借极其清晰的类别划分和产品页面结构,精准匹配了用户的 "选择与比较" 需求。

真实讨论的聚合器。Reddit、Yelp 等平台继续获益。它们汇聚了大量真实用户的第一视角讨论,时效性强,摩擦感真实——这是算法在评估内容可信度时越来越看重的信号。

深耕第一手数据的专业博客。持续投资于独立调查、拥有行业独家访谈或原始数据集的细分博客,在多个追踪报告中表现良好。这些内容的共同特征是:数据源独占,机器无法合成。

流量跌了,但可能不是排名掉了

这段时间有一个容易被误判的盲区。

Sistrix 和 CSW Agency 的报告都提到了所谓的 "SERP 流失" 现象:一些网站的流量下跌,并非因为在传统蓝色链接中失去了排名,而是因为 Google 在搜索结果中大量植入了新的界面元素——AI Overviews、产品推荐网格、讨论模块、本地服务包。

这些新元素在用户点击任何网站链接之前就满足了搜索意图。结果就是:你的排名可能还在第三、第四位,但点击被上面的 AI 答案截流了。这就是零点击搜索在 2026 年的具体表现。

所以在诊断流量下跌时,不要只看排名变化,要同时看 CTR 变化。如果排名稳定但 CTR 暴跌,问题不在你的内容质量,而在 SERP 布局的结构性改变。这个问题和核心更新本身无关,但和核心更新的影响叠加在一起,容易误判。

怎么区分三轮更新的影响

2026 年 Q1 实际叠加了多种不同性质的冲击,很多人在把它们混为一谈。在垃圾更新的分析里我已经讲过前两轮的区分方法,这里补上核心更新的维度:

实操判断方法:在 GSC 中切好日期段。3 月 24-25 日出现断崖式截断的页面,大概率是 SpamBrain 的定点清除;3 月 27 日之后出现渐进下滑的页面,才是核心更新在做质量重估。两者的应对策略完全不同——前者要清理违规,后者要提升内容价值。但是,短期的波动不代表真实的情况,因此要拉长时间再做评估。

更大的背景:搜索正在从 "检索" 变成 "代理"

如果只盯着排名波动,会错过 Q1 这一系列更新背后更大的信号。

2026 年被业界广泛认为是 "Agentic Web"(智能代理网络)加速落地的一年。AI 不再只是合成答案,而是开始具备自主执行能力——比价、下单、预约、审批,全在对话界面里完成。Google 今年推行的通用商业协议(UCP),正在让购物流程在 AI Mode 和 Gemini 应用内部封闭完成。

在这个背景下,核心更新对 "信息增益" 和 "结构化数据" 的重视就不难理解了。Google 需要的不是 "一篇写得还行的文章",而是 "AI 代理可以直接提取事实、进行交叉验证、完成交易的结构化数据源"。

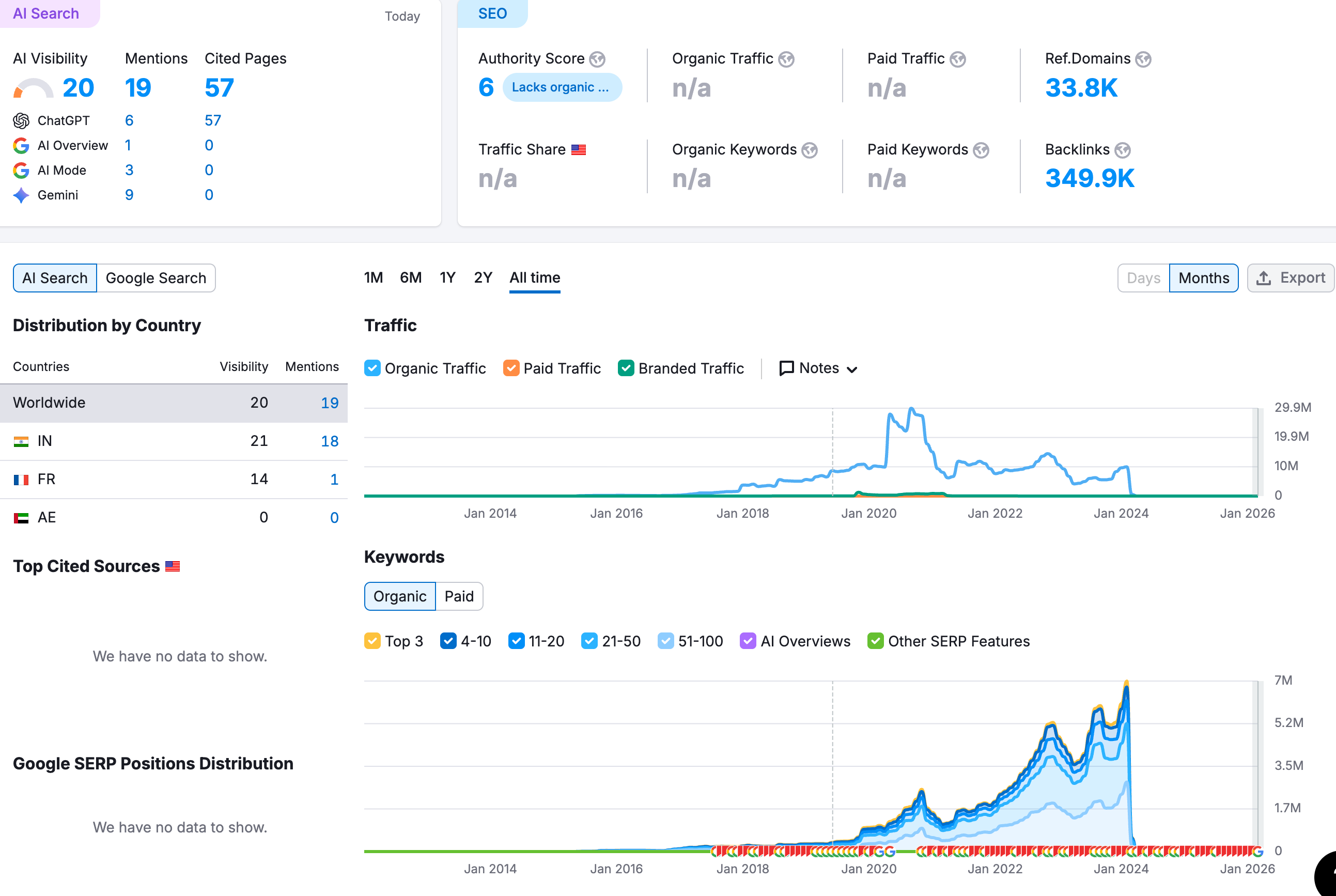

这也是为什么传统 SEO 正在让位于 GEO(生成式引擎优化)和 AEO(答案引擎优化)。衡量成功的指标正在从 "排名第几" 变成 "被 AI 引用了几次"。你的品牌在 AI 生成的回答中出现的频率——也就是 " 引用份额 "——才是新的流量货币。

现在该做什么

核心更新已于 4 月 8 日完成,但 Google 建议至少等一个完整周(4 月 15 日之后)再做正式复盘。现在是收集数据和制定策略的窗口期:

1. 建立基线,准备复盘。在 GSC 中导出 3 月 20-26 日(更新前)和 4 月 9-15 日(更新后稳定期)的数据,做正式的前后对比。更新刚结束的头几天排名可能还有余震,不要过早下结论。

2. 在 GSC 里做精细化隔离。用品牌词 / 非品牌词过滤器分开看。如果非品牌词流量暴跌而品牌词稳固,说明你的内容陷入了 "同质化惩罚"——信息增益不足,不是信任危机。同时对比 3.24-3.25 和 3.27 之后两个时间段,区分垃圾更新和核心更新的影响。

3. 审查你最重要的 20 篇页面。导出 GSC 中曝光量和排名下跌最严重的页面,逐一检查:有没有可验证的真实作者?有没有提供竞品文章里找不到的独家数据或观点?是不是在重复排名前十已有的内容?如果三个问题的答案都是否定的,这个页面就是核心更新的典型靶标。

4. 停止 "总结型" 内容生产。不要再让内容团队通过总结当前排名前十的文章来写大纲,更应该建立跨部门的增量信息搜集机制——挖掘 CRM 数据、访谈一线客户支持、引用独家测试数据。这些才是机器无法合成的第一手信息增益。

5. 把结构化数据当基础设施来投入。Schema Markup 不是可选项,它是让你的内容被 AI 代理准确解析的通行证。全面部署 FAQ、Article、Organization 标记,确保 SSR 让核心内容在初始 HTML 中就能被爬虫抓到。

6. 开始建设 "引用份额"。不要把所有精力放在自己的网站上。战略性地在 Reddit、行业论坛、权威媒体上建立品牌提及和专家观点。当大模型做知识检索增强(RAG)时,这些分散在多个可信节点上的品牌信号,会成为你被选为 "终极答案" 的关键背书。具体方法论参考我们的 GEO 中小企业指南和大企业 GEO 策略。

这篇文章的判断来自对 Search Engine Roundtable、Search Engine Land、Search Engine Journal 等一线信息源的实时跟踪,对 Lily Ray、Glenn Gabe 等顶尖分析师的公开分析,CSW Agency 的可见度报告,以及对 Reddit r/SEO、r/SaaS 等社区讨论的聚合分析。本文初版发布于 3 月 28 日(更新推送中),4 月 9 日更新为包含完整数据的终版。

.png)